ChatGPT, Claude, Perplexity, Gemini… Il n’y a jamais eu autant de choix et d’évolutions dans l’IA, difficile de s’y retrouver. Ici, je vais me concentrer uniquement sur ChatGPT et Claude, deux des acteurs majeurs de la course à l’IA, pour vous faire mon retour d’expérience. Je ne parle pas de Gemini parce que je ne l’ai pas assez poussé pour mes usages.

IA et LLM : de quoi parle-t-on ?

Avant de comparer quoi que ce soit, on reprend les bases. Parce que “IA” et “LLM”, c’est pas la même chose.

L’Intelligence Artificielle (IA)

L’IA (Intelligence Artificielle), c’est le concept global. C’est la capacité pour une machine de simuler une forme d’intelligence : comprendre, raisonner, apprendre, prendre des décisions. L’IA englobe un large éventail de technologies : vision par ordinateur, robotique, reconnaissance vocale, véhicules autonomes…

Le LLM (Large Language Model)

Un LLM (grand modèle de langage), c’est un type spécifique d’IA spécialisé dans le traitement du langage. Concrètement, c’est un réseau de neurones artificiels entraîné sur des quantités massives de texte pour comprendre et générer du langage humain.

ChatGPT et Claude sont des interfaces construites sur des LLM. Derrière ChatGPT, il y a les modèles GPT et o-series d’OpenAI. Derrière Claude, il y a les modèles Claude d’Anthropic.

Quand on dit “j’utilise l’IA”, en réalité on utilise un LLM à travers une interface conversationnelle. Le LLM, c’est le moteur. L’interface (ChatGPT, Claude…), c’est la voiture.

Agents, Skills et IA agentique

Quand on discute avec ChatGPT ou Claude dans un chat, on est dans un mode question/réponse classique. On pose une question, l’IA répond, et c’est tout. C’est utile, mais limité.

L’IA agentique, c’est l’étape d’après. Au lieu de simplement répondre, l’IA peut agir : lire des fichiers, exécuter des commandes, appeler des APIs, modifier du code, lancer des tests, et enchaîner ces actions de manière autonome pour atteindre un objectif. On ne lui dit plus “comment faire” étape par étape, on lui dit quoi faire, et il se débrouille.

Un agent, c’est donc un LLM auquel on a donné des outils (accès au terminal, au système de fichiers, à Git, à des APIs…) et la capacité de décider quand et comment les utiliser. Concrètement, voici ce qui se passe quand on donne une tâche à un agent de code :

- Il analyse la demande et le contexte (le codebase, les fichiers existants…)

- Il planifie les étapes nécessaires

- Il exécute : édite des fichiers, lance des commandes, crée des tests

- Il vérifie le résultat (erreurs de compilation, tests qui passent…)

- Il itère si quelque chose ne marche pas — et recommence jusqu’à ce que ça fonctionne

C’est exactement ce que font Codex et Claude Code : ce sont des agents. Un agent peut aussi lancer des sub-agents — des agents spécialisés qui travaillent en parallèle sur des sous-tâches (un pour le backend, un pour les tests, un pour la doc…).

Les skills (ou compétences), c’est un concept plus récent. Ce sont des extensions qu’on ajoute à un agent pour lui donner de nouvelles capacités ou des comportements préconfigurés.

Par exemple, un skill “frontend-design” qui permet à l’agent de générer des interfaces web soignées, ou un skill “project-planner” pour structurer et planifier un projet automatiquement.

Les skills sont comme des plugins : ils enrichissent l’agent avec des workflows spécialisés sans qu’on ait besoin de tout lui expliquer à chaque fois.

ChatGPT

OpenAI en bref

OpenAI est la société derrière ChatGPT. Fondée en 2015 comme organisation à but non lucratif, elle est devenue une entreprise commerciale à part entière, restructurée en PBC (Public Benefit Corporation) en octobre 2025 avec Microsoft détenant 27% des parts.

En quelques chiffres : 800 millions d’utilisateurs actifs par semaine, environ 20 milliards $ de revenus annuels fin 2025, et des investissements massifs avec le projet Stargate (500 milliards $ sur 4 ans pour construire des data centers IA aux États-Unis). Malgré ces chiffres, OpenAI affichait encore 5 milliards $ de pertes en 2024.

Les modèles

OpenAI a historiquement proposé deux familles de modèles : la série GPT (généralistes) et la série o (raisonnement). Avec GPT-5, les deux ont fusionné en un seul modèle.

| Modèle | Statut | Point fort |

|---|---|---|

| GPT-5.2 | Modèle par défaut | Modes Thinking et Instant |

| GPT-5.3-Codex | Nouveau (5 fév. 2026) | Code + raisonnement unifiés, 25% plus rapide |

| GPT-5-Codex-Mini | Version légère | ~4x plus d’usage par abonnement |

GPT-5.2 est le modèle par défaut dans ChatGPT depuis décembre 2025. Il regroupe les capacités des anciennes séries GPT et o en un seul modèle, avec un mode “Thinking” (raisonnement long) et un mode “Instant” (réponse rapide).

GPT-5.3-Codex, sorti le 5 février 2026, le même jour qu’Opus 4.6 d’Anthropic (TechCrunch), est le nouveau modèle phare pour le code. Il unifie code et raisonnement en un seul modèle 25% plus rapide, avec une fenêtre de contexte de 400K tokens. Fait notable : c’est le premier modèle OpenAI qui a contribué à son propre développement (OpenAI).

Tarifs : la version gratuite donne accès à GPT-5.2 avec des limites d’usage. L’abonnement Plus (20$/mois) débloque le mode Thinking, GPT-5.3-Codex, et relève les limites. Le plan Pro (200$/mois) offre un usage illimité avec priorité d’accès.

Codex : l’agent de code

Codex est l’outil d’OpenAI dédié au code, lancé en mai 2025. Il existe sous trois formes :

Codex Cloud : un agent qui tourne dans un environnement sandbox en ligne. On lui donne une tâche, il travaille en parallèle dans son bac à sable avec accès au repo, et propose des pull requests. C’est disponible directement dans ChatGPT pour les utilisateurs Plus.

Codex CLI : un agent en ligne de commande, open source et écrit en Rust. Il se lance dans le terminal, lit le code du projet, fait des modifications et exécute des commandes avec trois niveaux d’autonomie (lecture seule, auto, accès complet). Il supporte aussi le MCP, un protocole créé par Anthropic dont on reparle plus bas.

Codex App (macOS) : lancée le 2 février 2026, c’est une app native pour gérer plusieurs agents en parallèle, organisés par projet. Elle intègre le support des worktrees Git et un outil de code review intégré. Plus d’1 million de développeurs ont utilisé Codex le mois dernier.

À noter aussi : Apple Xcode 26.3 (en bêta) intègre désormais Codex et Claude Agent nativement, signe que les deux outils sont devenus incontournables.

Claude

Anthropic en bref

Anthropic est la société derrière Claude. Fondée en 2021 par d’anciens membres d’OpenAI (dont Dario et Daniela Amodei), elle se positionne sur la sécurité de l’IA comme priorité.

En quelques chiffres : une valorisation passée de 61,5 milliards $ à potentiellement 350 milliards $ début 2026, environ 27 milliards $ levés au total, et des investisseurs de poids comme Amazon (8 milliards $) et Google (~3 milliards $). Une IPO est en préparation pour 2026.

Les modèles

Anthropic propose trois gammes de modèles, avec le tout dernier Opus 4.6 :

| Modèle | Statut | Point fort |

|---|---|---|

| Haiku 4.5 | Modèle léger | Rapide, économique |

| Sonnet 4.5 | Modèle intermédiaire | Bon équilibre vitesse/intelligence |

| Opus 4.6 | Nouveau flagship (5 fév. 2026) | Adaptive Thinking, Agent Teams, 128K output |

Opus 4.6 est le tout dernier modèle. Il offre une fenêtre de contexte de 200K tokens (avec 1 million en bêta, réservé à l’API pour l’instant) et jusqu’à 128K tokens en sortie. Il introduit deux nouveautés majeures : l’Adaptive Thinking, où le modèle décide automatiquement quand activer le raisonnement étendu selon la complexité de la tâche, et les Agent Teams, qui permettent de lancer des équipes d’agents travaillant en parallèle et se coordonnant de manière autonome.

Côté performances, Opus 4.6 et GPT-5.3-Codex sont au coude-à-coude sur le code, tandis qu’Opus domine largement sur le raisonnement et les tâches complexes (OfficeChai, DigitalApplied).

Tarifs : la version gratuite donne un accès limité à Sonnet. L’abonnement Pro (20$/mois) débloque tous les modèles dont Opus. Le plan Max 5 (100$/mois) offre 5x plus de tokens, et le Max 20 (200$/mois) monte à 20x pour un usage intensif.

Le MCP : un standard qui a tout changé

Le MCP (Model Context Protocol) est un protocole ouvert créé par Anthropic en novembre 2024 pour standardiser la façon dont les IA se connectent à des outils et sources de données externes.

Avant le MCP, chaque intégration (lire un fichier, appeler une API, accéder à une base de données…) nécessitait un connecteur sur mesure. Le MCP a résolu ce problème en proposant une interface universelle.

L’adoption a été fulgurante : OpenAI l’a adopté en mars 2025, Google DeepMind en avril, puis Microsoft et GitHub ont rejoint le comité de pilotage. Fin 2025, c’est plus de 97 millions de téléchargements par mois et 10 000+ serveurs actifs. En décembre 2025, le MCP a été confié à l’Agentic AI Foundation sous la Linux Foundation, cofondée par Anthropic, Block et OpenAI.

Des serveurs MCP existent aujourd’hui pour GitHub, Notion, Figma, Stripe… C’est devenu le standard pour connecter une IA à n’importe quel outil.

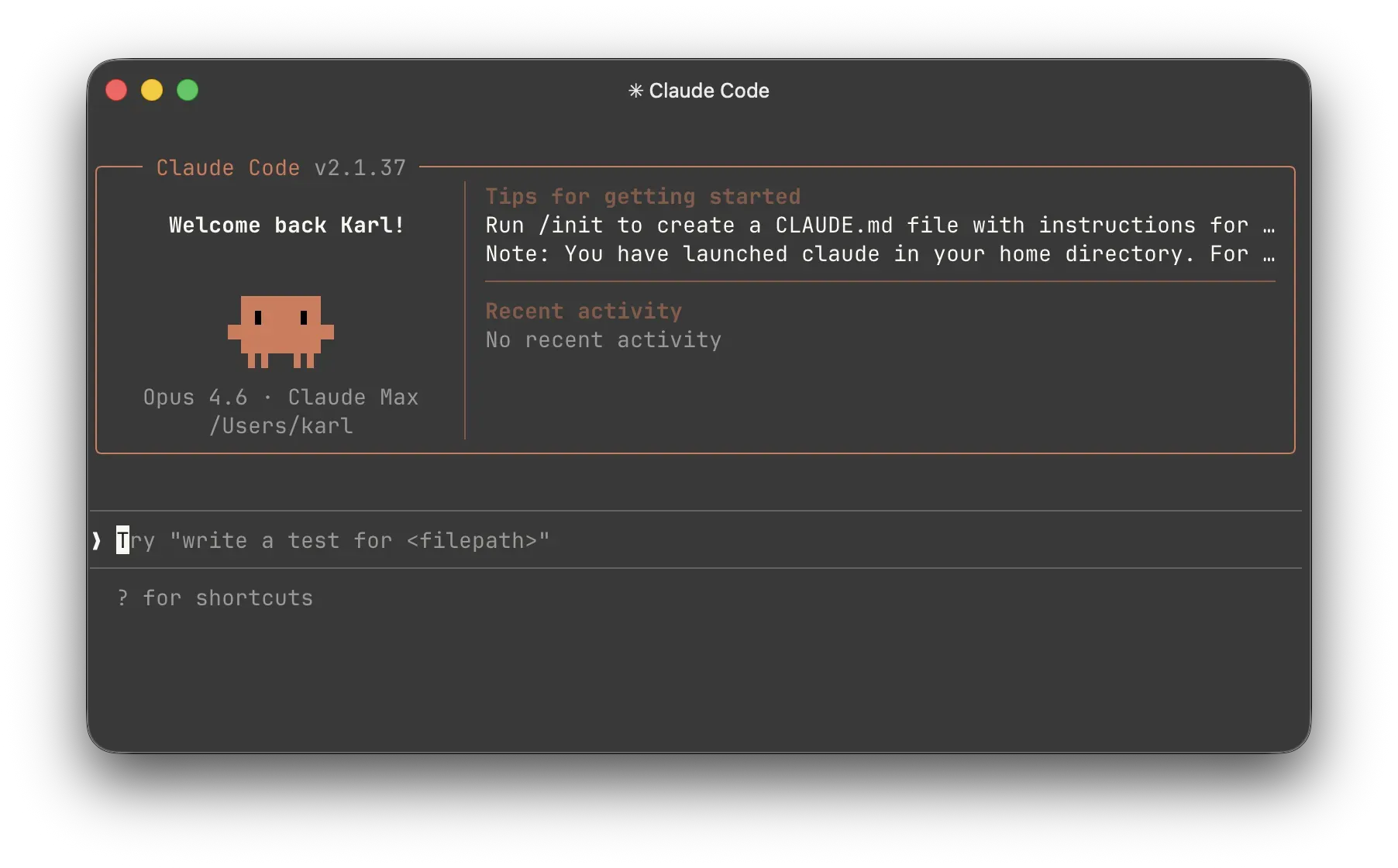

Claude Code : la force de frappe

Si Claude a un atout majeur, c’est Claude Code. Lancé en février 2025 et rendu GA en mai 2025 avec Claude 4, c’est un agent de code en langage naturel. Ce qui le rend puissant, c’est qu’il ne se contente pas de générer du code : il l’exécute, le teste, itère et corrige jusqu’à ce que ça marche. Il analyse tout le projet avant d’agir, pas juste le fichier ouvert. On peut configurer ses conventions via un fichier CLAUDE.md en markdown, et il les respecte automatiquement.

Il existe également sous plusieurs formes :

Claude Code CLI : l’agent en ligne de commande, le cœur du produit. Il vit dans le terminal, comprend le codebase, édite les fichiers, exécute des commandes et gère Git.

Claude Code IDE : intégré nativement à VS Code et JetBrains, il fonctionne directement dans l’éditeur avec le même moteur que le CLI.

Claude Desktop (macOS) : l’app native qui regroupe Chat, Code et Cowork, un onglet sorti en janvier 2026 pensé pour les non-développeurs. On donne accès à un dossier, on décrit ce qu’on veut en langage naturel, et il planifie et exécute de manière autonome.

Claude Code Web et Mobile : accessible depuis le navigateur sur claude.ai et via l’app iOS, pour ceux qui préfèrent une interface graphique.

Avec Opus 4.6, Claude Code gagne les Agent Teams : des équipes d’agents qui se répartissent le travail en parallèle (backend, tests, doc…) et se coordonnent de manière autonome. Il intègre aussi un système de skills et hooks pour personnaliser son comportement, le MCP pour se connecter à n’importe quel outil externe, et le Context Compaction (bêta) qui résume automatiquement le contexte ancien pour maintenir des sessions longues sans perdre le fil.

Pour profiter des Agent Teams et du maximum de tokens en sortie (jusqu’à 128K avec Opus 4.6), il suffit de configurer le fichier ~/.claude/settings.json :

{

"env": {

"CLAUDE_CODE_EXPERIMENTAL_AGENT_TEAMS": "1",

"CLAUDE_CODE_MAX_OUTPUT_TOKENS": "128000"

}

}ChatGPT ou Claude : que choisir ?

La réponse honnête : ça dépend de votre usage. Les deux sont des outils excellents, mais ils ne brillent pas dans les mêmes domaines.

Le comparatif

| Critère | ChatGPT | Claude |

|---|---|---|

| Usage quotidien | Excellent, très polyvalent | Très bon, un peu moins de fonctionnalités intégrées |

| Recherche web | Natif et performant | Natif et performant |

| Génération d’images | DALL-E intégré nativement | Pas de génération d’images… |

| Rédaction | Bonne, parfois un peu générique | Naturelle, plus nuancée et peut s’adapter au style de l’utilisateur |

| Écosystème | GPT Store, Codex App | MCP, Skills, Hooks, Agent Teams |

| Prix | Gratuit / 20$ / 200$ | Gratuit / 20$ / 100$ / 200$ |

Codex vs Claude Code

Pour le code spécifiquement, c’est le match qui m’intéresse le plus :

| Critère | Codex (GPT-5.3-Codex) | Claude Code (Opus 4.6) |

|---|---|---|

| Open source | Oui (CLI en Rust) | Non |

| Contexte | 400K tokens | 200K tokens (1M en bêta API) |

| Output max | Non communiqué | 128K tokens |

| Multi-agents | Oui (Codex App, worktrees) | Oui (Agent Teams, sub-agents) |

| Adaptive Thinking | Non | Oui (ajuste son effort automatiquement) |

| Context Compaction | Non | Oui (sessions longues sans perte) |

| Configuration projet | codex.md | CLAUDE.md, hooks, skills |

Les deux modèles sont sortis le même jour et chacun excelle dans son domaine. Côté contexte, Codex prend l’avantage avec 400K tokens contre 200K pour Claude Code en abonnement (le 1M est réservé à l’API pour l’instant). Ce qui fait la différence pour moi côté Claude : l’Adaptive Thinking qui ajuste automatiquement son effort de raisonnement, le Context Compaction qui permet des sessions plus longues sans perdre le fil et la possibilité d’y ajouter des skills.

Mon expérience perso

J’utilise ChatGPT en version gratuite de temps en temps pour les questions rapides, un peu de recherche web et la génération d’images. Mais le plus clair de mon temps, c’est avec Claude, et notamment Claude Code pour le développement, la rédaction, les scripts, le debug, le brainstorming… Il m’aide même à rédiger mes articles en gardant mon ton et mon style. Et sur les tâches complexes, la fenêtre de contexte plus grande et la capacité de concentration sur la durée font une vraie différence.

Pour le code, il a clairement pris le dessus dans mon workflow. C’est rapide, fiable, précis, et surtout facile à diriger avec le fichier CLAUDE.md. On définit les conventions du projet une fois, et il les respecte.

Un autre point fort : les commandes personnalisées. On peut créer ses propres commandes pour ne pas se répéter, et ça change vraiment le workflow. Par exemple, j’ai un /go pour reprendre une session (il relit la todolist, le sprint en cours, les fichiers concernés et sait directement où rattaquer), un /done pour mettre à jour la todolist, et un /status pour savoir où on en est dans le développement.

Conclusion

Chaque IA a ses forces. ChatGPT reste un couteau suisse polyvalent, parfait pour un usage quotidien diversifié. Claude, avec son écosystème d’outils pensé pour les développeurs, a trouvé sa niche et l’occupe très bien.

Mon choix : j’ai résilié ChatGPT Plus pour ne garder que Claude Max. Quand j’ai fait ce choix, Codex n’en était pas encore là. Aujourd’hui, sur le papier, il a clairement rattrapé son retard. Mais après plus de six mois d’utilisation intensive, Claude Code a tellement transformé ma façon de travailler que je n’ai aucune raison de changer. Pour le reste (questions rapides, recherche web, génération d’images), la version gratuite de ChatGPT me suffit largement.

Mes reproches : pas de génération d’images (obligé de passer sur ChatGPT ou Midjourney quand j’en ai besoin) et les limites d’utilisation qui se font sentir, même sur le plan Max. Lors de sessions intensives avec Claude Code, il m’arrive d’atteindre le plafond. Ce n’est pas un tout-en-un, mais pour mon usage principal, c’est le meilleur investissement.

La course entre OpenAI et Anthropic est loin d’être terminée. Les modèles évoluent régulièrement et rapidement. Ce qui est vrai aujourd’hui ne le sera peut-être plus dans six mois. Mais pour l’instant, mon choix est fait 😁.

Liens utiles :